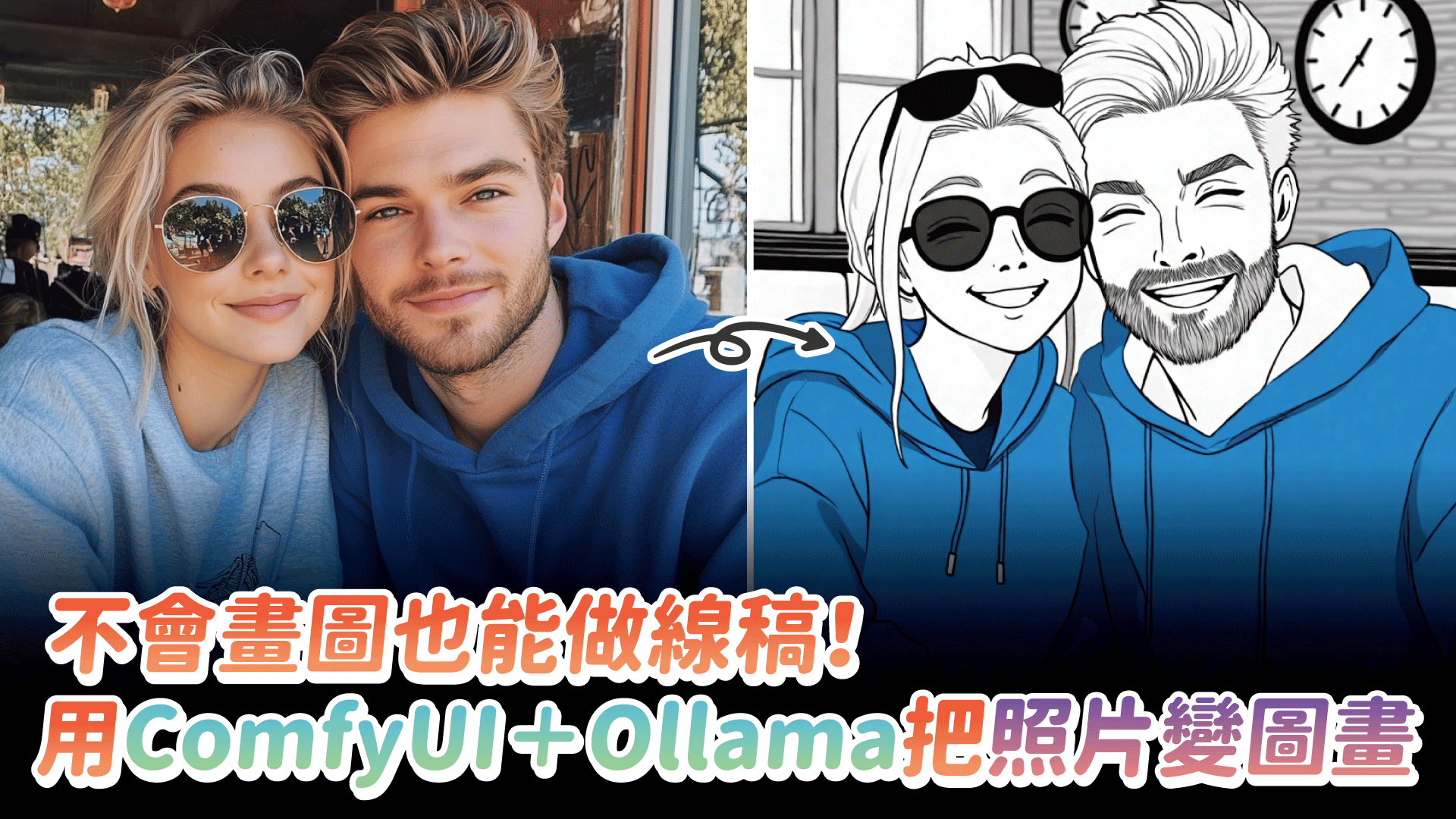

不會畫圖也能做線稿!用ComfyUI+Ollama把照片變圖畫

使用 FLUX ControlNet 的工作流,搭配 Ollama 模型,將圖片快速轉換成簡單的線條圖。只需要幾個步驟就能完成。首先,我們會安裝 Ollama 節點與模型,這樣就能讓系統自動辨識圖片內容,免去手動輸入描述的麻煩。接著會示範如何下載並安裝 Ollama,以及啟動 llava-phi3 模型來完成圖像辨識。之後只要開啟 ComfyUI,把工作流拉進來,上傳圖片,點擊生成,就能得到乾淨俐落的線條圖。不需複雜參數設定,效果卻非常實用。適合用來做繪圖底稿、風格轉換、或是AI繪圖前置處理。想知道怎麼做就趕快看下去吧!